近日,我院激光与智能光学感知研究所以“Knowledge distillation and teacher–student learning in medical imaging: Comprehensive overview, pivotal role, and future directions(医学影像中的知识蒸馏和师生网络学习:全面概述、关键作用和未来方向)”为题在医学影像与人工智能领域国际顶级刊物《Medical Image Analysis》(中科院一区TOP,影响因子11.8)上发表论文。我院教师李翔为第一作者,赵勇教授为通讯作者,东北大学秦皇岛分校为第一完成单位。

随着深度学习技术在医学影像分析中的广泛应用,人工智能已成为辅助诊断、疾病检测和医学研究的重要工具。然而,高性能深度学习模型通常依赖复杂的网络结构和大量高质量标注数据,这在医学领域往往难以实现。一方面,大规模标注医学影像需要专业医生参与,成本高且耗时长;另一方面,大型模型计算资源需求高,难以在临床设备或实时系统中部署。因此,如何在保证模型性能的同时降低模型复杂度、提升数据利用效率,成为医学人工智能研究中的重要问题。

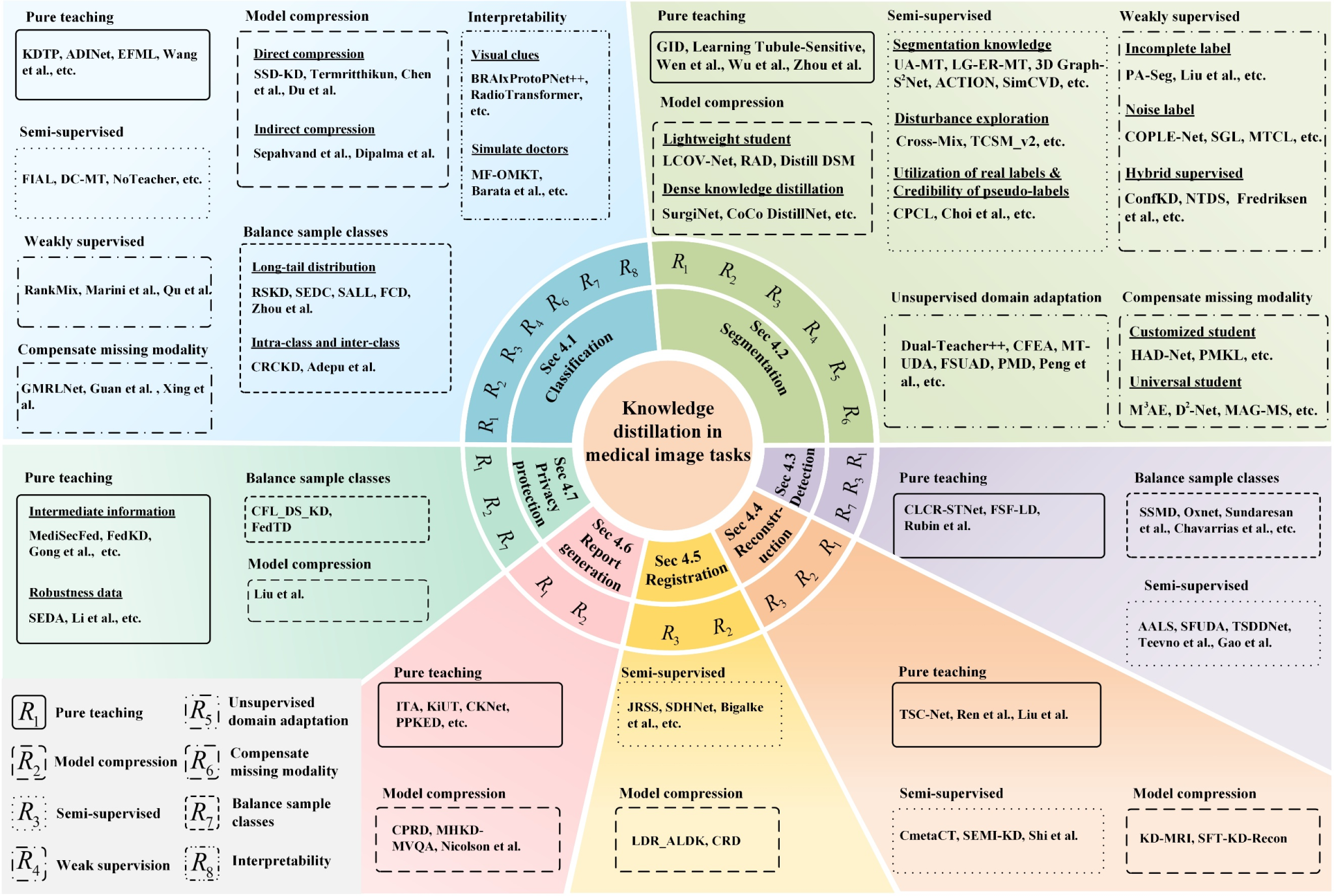

知识蒸馏技术为解决上述问题提供了有效途径。该技术通过构建“教师—学生(Teacher–Student)”学习框架,将复杂模型(教师模型)中蕴含的知识迁移到结构更简单的学生模型中,从而实现模型压缩与性能优化。在本文中,作者系统总结了知识蒸馏在医学影像领域的应用,并从多个维度对相关方法进行了深入分析。论文首先介绍了知识蒸馏的基本原理,包括经典的教师—学生网络结构,基于目标、基于特征及基于关系的蒸馏等多种知识类型。随后,研究团队进一步总结了知识蒸馏在医学影像分析中主要发挥的八个重要作用,包括:提升模型性能、模型压缩、半监督学习、弱监督学习、无监督域适应、模态缺失、样本类别不平衡以及模型可解释性。这些功能使得知识蒸馏不仅能够提高算法效率,还能够增强模型在实际医疗场景中的可用性和可靠性。论文还对当前该领域面临的关键挑战进行了分析,针对性的提出了大模型与知识蒸馏结合、终身学习框架、跨模态知识迁移以及更高效的模型压缩技术等解决方案。

图1. 本文对不同知识蒸馏方法在医学图像任务中的应用总结概述。包括提升模型性能、模型压缩、半监督学习、弱监督学习、无监督域适应、模态缺失、样本类别不平衡以及模型可解释性等。

论文链接:https://doi.org/10.1016/j.media.2025.103819

(编辑:周宣任 审核:陈茂庆)